Reconnaissance faciale dans l’espace public : application et limites

Fini l’époque où la reconnaissance faciale n’était qu’une technologie imaginée par des auteurs de science fiction. Cette technologie est aujourd’hui bien réelle et fait déjà l’objet de nombreuses applications dans notre quotidien. L’utilisation de la reconnaissance faciale peut être grandement utile dans de nombreux domaines mais peut aussi susciter l’inquiétude de la population, notamment lorsqu’elle est utilisée pour contrôler.

Un bref aperçu de la reconnaissance faciale

Tout d’abord, qu’est-ce que c’est ? La réponse est dans le nom. Il s’agit d’un moyen d’identifier ou de confirmer l’identité d’un individu grâce à son visage. L’utilisation la plus connue est celle qui permet de déverrouiller son smartphone en particulier grâce à “Face ID” d’Apple. Cette reconnaissance faciale ne fait qu’identifier et reconnaître une personne comme propriétaire unique de l’appareil, pour empêcher autrui d’y avoir accès. Elle ne fonctionne pas donc sur une immense base de données de photos.

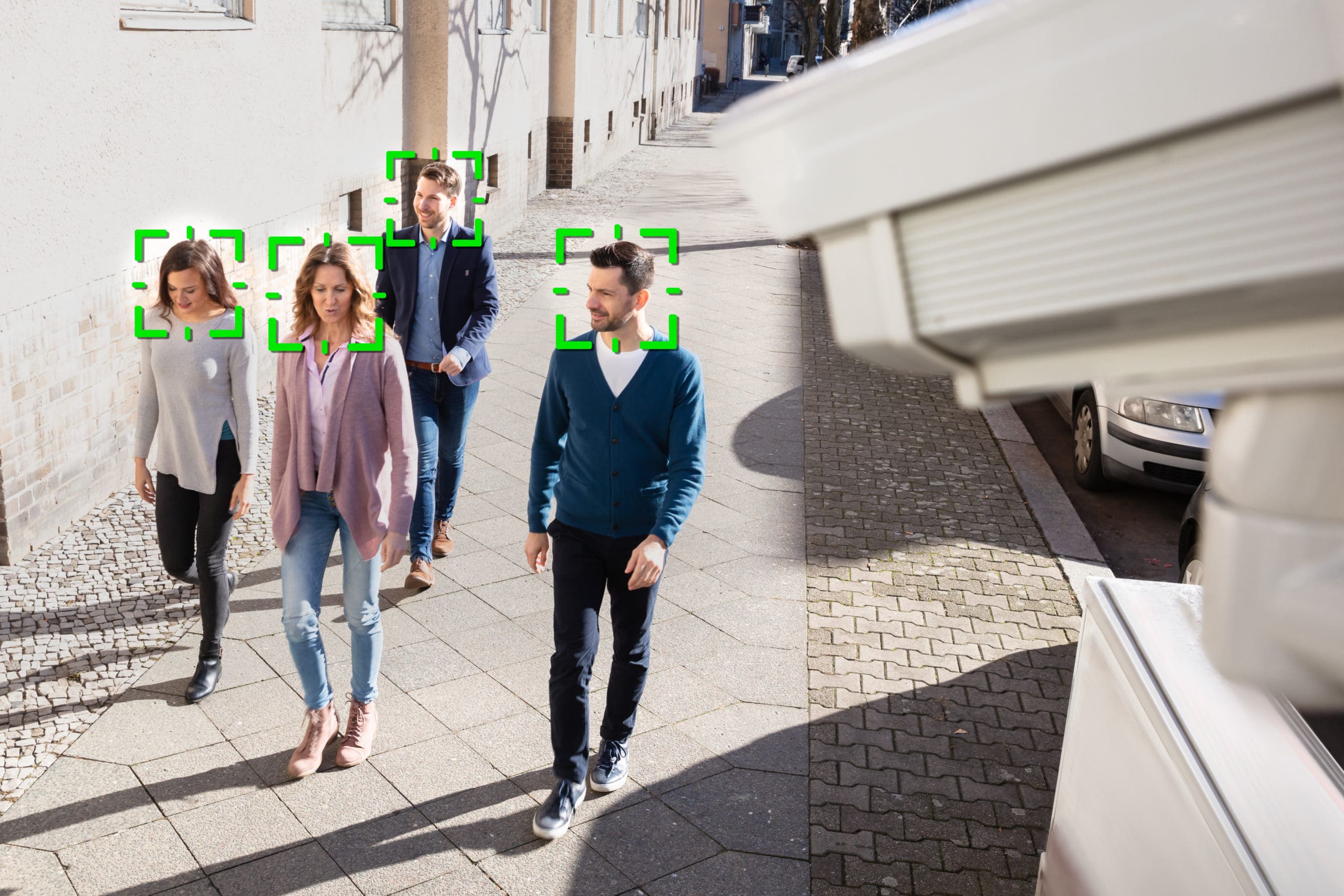

En revanche, la reconnaissance faciale est également (et majoritairement) utilisée pour sécuriser certains bâtiments ou l’espace public. Ce type d’utilisation suscite naturellement des interrogations d’ordre juridique. Par exemple, on peut s’interroger sur la proportionnalité du dispositif, d’identification normalement appliqué aux criminels à toute la population suspecte par défaut. Se pose également la question de la fin de l’anonymat dans l’espace public.

La technologie est pourtant déjà développée dans certains pays, en particulier en Chine où des algorithmes permettent de suivre les individus avec une précision terrifiante. La reconnaissance faciale permet au gouvernement chinois de savoir qui commet des infractions. Une fois l’infraction commise, leur photo et des extraits de leur numéro de carte d’identité et de leur adresse sont affichés sur des panneaux vidéos placés dans la rue. Cette technologie est d’autant plus critiquable qu’elle permet notamment aux autorités de connaître les personnes qui participeraient à des manifestations.

Une technologie basée sur de nombreuses données personnelles

Pour que la reconnaissance faciale puisse fonctionner, il faut une vaste base de données collectées dans des conditions naturelles pour l’entraînement des modèles. La première base de données utilisée était les photos d’identité. Le problème, c’est que les photos d’identité et les photos dans la rue sont drastiquement différentes ce qui donnait un système très aléatoire. Pour que le système fonctionne correctement, il faut plus d’images et il est nécessaire de capter en continue des images des gens dans la rue, sans qu’ils sachent la destination et les finalités de celles-çi.

En Europe ce genre d’usage se heurte à la législation en matière de protection des données personnelles : le Règlement général sur la protection des données (le RGPD). En effet, la reconnaissance faciale, comme on l’a vu, recueille des données biométriques pour fonctionner, c’est-à-dire des données qui permettent de reconnaître automatiquement un individu à partir de ses caractéristiques physiques, physiologiques ou comportementales (empreintes digitales, réseau veineux, iris, reconnaissance vocale etc.). Selon le RGPD, les données biométriques appartiennent à la catégorie dite des “données sensibles” (article 9 du RGPD). Le traitement de ces données est en principe interdit. Mais au regard de la longue liste d’exceptions, pas sûr que le régime en place soit un bon cadre juridique pour la reconnaissance faciale.

Un projet de cadre européen spécifique à l’intelligence artificielle

Peut-être que le futur règlement européen visant à harmoniser l’utilisation de l’intelligence artificielle au sein de l’Union saura proposer une meilleure protection des libertés individuelles tout en assurant la sécurité des biens et des personnes. La Commission européenne a révélé une proposition de loi concernant l’intelligence artificielle le 21 avril 2021. Cette proposition de loi concerne notamment la reconnaissance faciale qui se base de plus en plus sur l’intelligence artificielle pour fonctionner. L’intelligence artificielle pourrait en effet se définir comme “l’ensemble des technologies qui permettent à la machine de reproduire des comportements considérés comme intelligents par les humains” (définition donnée par Nicolas Méric, CEO de DreamQuark).

L’objectif principal de cette proposition de loi est d’arriver à un équilibre entre d’un côté la gestion des risques que génèrent l’IA et, d’un autre côté, la flexibilité nécessaire au développement technologique afin d’éviter des coûts de mise sur le marché disproportionnés. La Commission propose de classer les utilisations d’intelligence artificielle en trois catégories afin de proposer des recommandations différenciées en fonction des classifications.

La CNIL a réagi à cette proposition de loi dans un avis rendu le 18 juin 2021. Elle recommande d’interdir des systèmes biométriques utilisés aux fins de classer les individus dans des groupes basés sur l’ethnicité supposée, le sexe, l’orientation politique ou sexuelle, ou d’autres motifs pour lesquels la discrimination est interdite en vertu de l’article 21 de la Charte des droits fondamentaux de l’Union européenne. De plus, l’utilisation de systèmes d’IA pour déduire les émotions d’une personne physique est considérée comme hautement indésirable et devrait également être soumise à une interdiction de principe (sauf cas très spécifiques, tels que certains objectifs de santé). Enfin, les systèmes utilisés pour la notation sociale (« social scoring ») doivent être systématiquement interdits.

Un futur contrôleur européen des systèmes d’intelligence artificielle ?

Si des cadres juridiques commencent peu à peu à voir le jour, le plus grand enjeu sera de limiter le traitement des données à caractère personnel. En application du RGPD et de la directive « Police-Justice », la CNIL régule déjà des systèmes d’IA impliquant des données personnelles.

Si la proposition de loi est adoptée, il est primordial d’investir un contrôleur européen capable de vérifier que la législation s’applique uniformément et surtout factuellement au sein de tous les Etats membres. Afin de limiter les risques d’insécurité juridique et de difficultés administratives, les entreprises et les pouvoirs devront pouvoir facilement s’adresser à un interlocuteur unique qui serait chargé de la régulation de l’intelligence artificielle, et donc de la reconnaissance faciale. La Commission pourrait ainsi faire le choix de confier cette mission concernant les systèmes d’intelligence artificielle à une autorité déjà existante : le contrôleur européen de la protection des données.

AliceM, un système de reconnaissance faciale bientôt développé en France ?

Tandis que l’Europe se creuse la tête pour trouver un équilibre entre régulation et innovation, la France, elle, réfléchit parallèlement à un système qui permettrait aux citoyens français de faire leurs démarches administratives en se connectant à une seule application… grâce à leur visage.

Cette application permettrait de doter chaque français d’une identité numérique propre afin de se connecter plus facilement en ligne et d’éviter les usurpations d’identité. Mais cette application fait débat car, justement, elle utiliserait des données biométriques (à savoir le visage). Pour créer un compte, l’usager entrera ses informations traditionnelles à savoir son email, son numéro de sécurité sociale, son prénom etc. et renseignera son passeport ou son titre de séjour (qui devra être obligatoirement muni d’une puce). Enfin, l’usager devra passer une série de tests pour configurer la reconnaissance faciale nécessaire à sa connexion. A l’instar de ce qui existe déjà sur les smartphones, chaque français sera donc invité par l’Etat, à tourner la tête et sourire pour que l’application compare les résultats avec la photo figurant sur le passeport ou le titre de séjour.

Seulement, la CNIL et ses opposants pointent du doigt le fait que cette application va à l’encontre du RGPD. En effet, comme il a été dit précédemment, les données biométriques sont des données sensibles qui nécessitent le consentement des personnes concernées. Or, le consentement ne peut être libre et éclairé lorsque le refus de se soumettre à la reconnaissance faciale empêche la création d’un compte.

L’Agence Nationale des Titres Sécurisés (ANTS) rétorque que la création d’un compte AliceM restera facultative et que les moyens d’accès aux services publics existants resteront valables. Quant au stockage des données, l’ANTS précise que les photographies et vidéos des personnes seront transmises à l’agence mais seront aussitôt détruites dès que la reconnaissance sera terminée. Mais comme chacun le sait, le risque zéro n’existe pas. Les hackers pourront donc accéder à ces données grâce à des failles techniques, ce qui peut causer de grands préjudices pour les personnes concernées. De plus, la reconnaissance faciale est encore une technologie récente qui est encore défaillante sur certains points. Il est donc nécessaire de se demander si la démocratisation d’une telle technologie est nécessaire pour accéder aux services publics et si l’accepter n’est pas déjà un premier pas vers une société de surveillance.

La reconnaissance faciale dans le monde

Sans prendre l’exemple extrême de la Chine, la reconnaissance faciale fait déjà ses preuves dans plusieurs pays. En revanche, difficile de parler de “reconnaissance faciale” lorsqu’on parle de l’Espagne. La ville de Marbella a choisi d’avoir recours à une intelligence artificielle afin d’analyser les images de plus de 80 caméras de vidéosurveillance. Cependant, l’Espagne est elle aussi soumise au RGPD, ce qui signifie que le traitement des données biométriques est en principe interdit. L’Espagne a donc “contourné” cette interdiction en utilisant une intelligence artificielle qui se base non pas sur des données biométriques mais sur l’apparence générale des personnes comme la couleur des vêtements, l’âge, le genre etc. Il faudrait donc plus parler d’un système de reconnaissance corporelle plutôt qu’un système de reconnaissance faciale.

Aux Etats-Unis, il existe une grande défiance vis-à-vis de cette technologie de la part des citoyens où on observe la multiplication de moratoires. Pourtant, au début de son implantation, les autorités de police voyaient dans cette technologie une aubaine pour faciliter leur travail. Avec un cadre juridique extrêmement floue, la reconnaissance faciale n’était limitée par aucun cadre et de nombreux abus existaient au sein même de la police. Ainsi, il n’était pas rare que les policiers ne déclarent pas l’usage de cette technologie. De plus, aucune certification policière n’était demandée pour acheter un système de reconnaissance faciale. Les bases de données étaient remplis de personnes arrêtées mais non condamnées. Enfin, les policiers utilisaient parfois la reconnaissance faciale afin d’identifier qui participait à des manifestations précises. Seulement, depuis quelques années, les Etats américains se sont rendus compte que cette technologie était encore défaillante dans la mesure où celle-ci favorise les biais racistes. De nombreuses voix affirment que cette technologie peut mener à l’arrestation de personnes innocentes avec des conséquences dangereuses, menaçant la vie privée et même la vie des gens. Par exemple, une chercheuse du Massachussets Institute of Technology, Joy Buolamwini, a remarqué que ces logiciels faisaient moins d’1% d’erreur sur un homme blanc, mais 35 à 38% pour une femme de couleur. Le système de reconnaissance faciale est donc susceptible de renforcer les discriminations au lieu d’être un contrôle objectif comme ses promoteurs le vendent.

Reconnaissance faciale : quel bilan en France ?

Si la reconnaissance faciale en temps réel n’est toujours pas autorisée en France, des expérimentations ont pourtant déjà eu lieu dans plusieurs communes. Par exemple, la ville de Nice a testé cette technologie lors du carnaval de Nice de 2019. 500 personnes étaient volontaires pour participer à l’expérience.

Le même dispositif a été installé à Cannes pendant le confinement afin de vérifier que les habitants portaient bien leur masque en allant au marché. Seulement, cette fois-ci, les personnes n’étaient pas informées de la mise en place de ce dispositif, ce qui a tout de suite fait réagir la CNIL.

Pour citer un dernier exemple, la région PACA avait saisi la CNIL afin d’expérimenter la reconnaissance faciale aux portiques des lycées. Après un examen attentif du projet, la CNIL a considéré que le dispositif projeté est contraire aux grands principes de proportionnalité et de minimisation des données posés par le RGPD. Elle précise que des dispositifs de contrôles bien moins intrusifs étaient possibles comme l’accès au lycée au moyen d’un badge.

Toutes ces expérimentations montrent que l’implémentation de la reconnaissance faciale en France est très délicate et ce grâce (ou à cause du) au RGPD. Ce règlement rappelle à l’Etat français que le consentement doit être au coeur de l’utilisation d’un tel dispositif. Le RGPD et la proposition de loi sur l’IA font en sorte de protéger en premier lieu les libertés fondamentales de personnes et d’éviter que la reconnaissance faciale devienne une technologie normalisée. Face à un cadre juridique de plus en plus précis et à un développement de la technologie de plus en plus performant, difficile d’imaginer l’avenir de la reconnaissance faciale en France et plus globalement, en Europe.

Nos services en la matière

Nos avocats peuvent vous accompagner dans de multiples domaines de l’innovation tels que la propriété intellectuelle, la blockchain, le droit pénal du numérique, le droit du travail et bien d’autres.

Nos services :

- Réalisation de notes juridiques

- Notes d’intelligence juridiques

- Communication pour des cabinets d’avocats

- Elaboration d’outils technologiques utiles pour le droit

- Litiges, conseils, corporate, rédaction d’actes

Que ce soit en matière contentieuse ou en matière consultative, que vous soyez une entreprise ou une personne physique, le cabinet Legal Brain Avocats saura vous offrir une assistance optimale et personnalisée selon vos besoins.

Pour plus d’informations, rendez-vous sur l’article rédigé par Me Yann-Maël LARHER dans l’Opinion.

Article rédigé par Florian PESCE, juriste chez Legal Brain Avocats (LinkedIn).